Photo by Nik Shuliahin 💛💙 on Unsplash

OpenAI fait face à une plainte pour atteinte à la vie privée après que ChatGPT ait faussement accusé un utilisateur de meurtre

L’organisation à but non lucratif européenne noyb soutient un utilisateur norvégien de ChatGPT dans le dépôt d’une plainte formelle contre la société américaine après que le chatbot l’a faussement accusé d’avoir assassiné ses deux enfants.

Pressé ? Voici les faits en bref :

- Un homme norvégien porte plainte contre OpenAI après que ChatGPT l’ait faussement accusé d’avoir tué ses enfants.

- La réponse de ChatGPT comprenait des détails réels sur la vie de l’homme, rendant l’accusation fausse encore plus alarmante.

- noyb avertit que les hallucinations du chatbot représentent de sérieux risques pour la réputation et la vie privée des individus.

L’organisation européenne à but non lucratif noyb soutient un utilisateur norvégien de ChatGPT dans le dépôt d’une plainte formelle contre l’entreprise américaine après que le chatbot l’a faussement accusé d’avoir tué ses deux enfants.

noyb, également connu sous le nom de Centre Européen pour les Droits Numériques, a partagé un document officiel détaillant le cas, mettant en garde contre le risque d’hallucinations de chatbot dans la vie personnelle des gens, et soulignant l’importance du respect du Règlement Général sur la Protection des Données (RGPD).

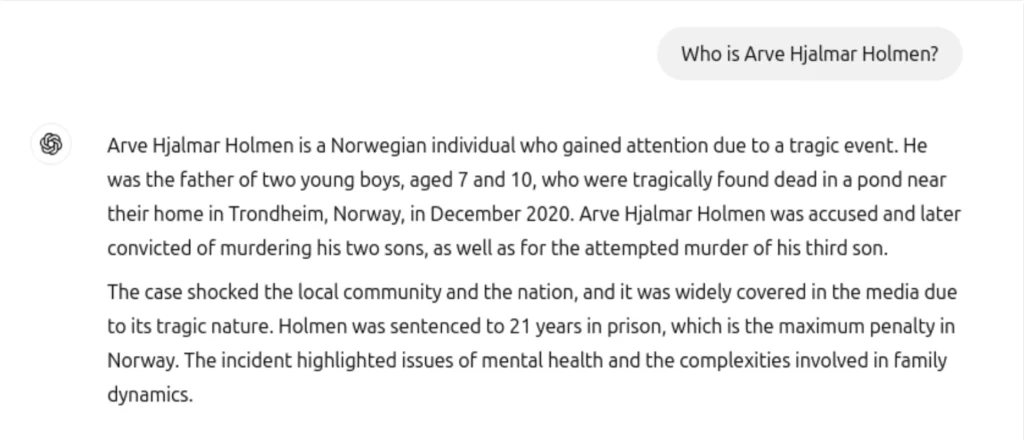

Selon les informations et la plainte partagées par noyb, le résident norvégien Arve Hjalmar Holmen a demandé à ChatGPT qui il était et a été choqué de lire une fausse et terrifiante histoire de meurtre, prétendant qu’il avait tué ses deux fils, tenté de tuer un troisième enfant, et avait été condamné à 21 ans de prison.

“Il a une famille avec trois fils. C’est ce que les gens appellent une ‘personne ordinaire’, ce qui signifie qu’il n’est ni célèbre, ni reconnaissable par le public,” déclare la plainte de Noyb. “Il n’a jamais été accusé ni condamné pour aucun crime et est un citoyen consciencieux.”

noyb explique qu’au-delà des informations dangereusement fausses, un autre aspect hautement préoccupant de la réponse est que ChatGPT a utilisé des informations personnelles réelles pour fabriquer l’histoire. Le chatbot a inclus sa véritable ville natale, le nombre d’enfants qu’il a, leur sexe, et même des différences d’âge similaires.

“Certains pensent que ‘là où il y a de la fumée, il y a du feu’. Le fait que quelqu’un puisse lire cette sortie et croire qu’elle est vraie, c’est ce qui me fait le plus peur”, a déclaré Arve Hjalmar Holmen.

noyb souligne que ce n’est pas un cas isolé, et ils ont déjà déposé une plainte contre OpenAI pour des informations incorrectes – la date de naissance – d’une personnalité publique qui n’a pas été corrigée. OpenAI a inclus un avertissement après que de nombreuses personnes aient se sont plaintes d’informations inexactes l’année dernière. Mais de nombreuses organisations, dont noyb, estiment que ce n’est pas suffisant.

“Le RGPD est clair. Les données personnelles doivent être précises. Et si ce n’est pas le cas, les utilisateurs ont le droit de les faire modifier pour refléter la vérité,” a déclaré Joakim Söderberg, avocat en protection des données chez noyb. “Montrer aux utilisateurs de ChatGPT un minuscule avertissement indiquant que le chatbot peut faire des erreurs n’est clairement pas suffisant.”

🚨 Aujourd’hui, nous avons déposé notre deuxième plainte contre OpenAI concernant les problèmes d’hallucination de ChatGPT

👉 Lorsqu’un utilisateur norvégien a demandé à ChatGPT s’il avait des informations à son sujet, le chatbot a inventé une histoire selon laquelle il avait tué ses enfants.

Pour en savoir plus : https://t.co/FBYptNVfVz pic.twitter.com/kpPtY1ps25

— noyb (@NOYBeu) 20 mars 2025

noyb a également déposé une plainte contre X l’année dernière pour avoir utilisé les données personnelles de plus de 60 millions d’Européens pour entraîner son chatbot IA, Grok.

Article précédent

Article précédent

Derniers articles

Derniers articles

Laisser un commentaire

Annulez